Agathe Balayn

Μπορείτε να μας πείτε λίγα λόγια για το πώς «μαθαίνουν» τα συστήματα μηχανικής μάθησης και πώς διαδίδονται τα στερεότυπα μέσω αυτών των τρόπων μηχανικής μάθησης;

Για τη χρήση εργαλείων μηχανικής εκμάθησης υπάρχουν δύο κύρια στάδια, το πρώτο στάδιο είναι η εκπαίδευση του μοντέλου και το δεύτερο είναι η χρήση του στην πράξη.

Για να εκπαιδεύσουμε το μοντέλο, πρέπει να συλλέξουμε ένα σύνολο δεδομένων (datasets) και αυτό είναι γεμάτο από αυτά που θέλουμε το μοντέλο να προβλέψει στη συνέχεια, οπότε αν μιλάμε για HR, για παράδειγμα, μιλάμε για τη συλλογή βιογραφικών σημειωμάτων ατόμων που προσλήφθηκαν κάποια στιγμή από τον οργανισμό, και ατόμων που θέλουμε να προσλάβουμε. Έχουμε λοιπόν τα σύνολα δεδομένων και μετά επιλέγουμε τους αλγόριθμους, που είναι ένα σύνολο εξισώσεων με κάποιες παραμέτρους που πρέπει να διορθωθούν. Στη συνέχεια, κάνουμε αυτό που ονομάζουμε “εκπαίδευση του αλγορίθμου” που αποφασίζουμε επί των παραμέτρων τους, χρησιμοποιώντας τα datasets που ετοιμάσαμε πρώτα. Η ιδέα είναι ότι ελπίζουμε ότι στο τέλος οι παράμετροι θα αντιπροσωπεύουν το περιεχόμενο των συνόλων δεδομένων που έχουμε, έτσι ώστε αργότερα όταν χρησιμοποιείτε τον αλγόριθμο με τις παραμέτρους, εάν έχουμε π χ ένα νέο βιογραφικό σημείωμα, θα πρέπει να είμαστε σε θέση να προβλέψουμε με βάση τα αποτελέσματα, εάν πρέπει να προσλάβουμε ένα άτομο ή όχι.

Για την αποτελεσματική αξιοποίηση των εργαλείων μηχανικής εκμάθησης, υπάρχουν δύο κύρια στάδια: η εκπαίδευση του μοντέλου και η χρήση του σε πρακτικές εφαρμογές. Κατά τη φάση της εκπαίδευσης, πρέπει να συλλέγονται datasets, τα οποία να περιέχουν σχετικές πληροφορίες ώστε το μοντέλο να προβλέπει μελλοντικά αποτελέσματα. Για παράδειγμα, στο πλαίσιο του HR, αυτό θα μπορούσε να περιλαμβάνει τη συλλογή βιογραφικών σημειωμάτων προηγουμένως προσληφθέντων ατόμων μαζί με αυτά των πιθανών υποψηφίων.

Αφού συγκεντρωθούν τα datasets, το επόμενο βήμα είναι η επιλογή κατάλληλων αλγορίθμων, οι οποίοι αποτελούνται από μια σειρά εξισώσεων με ρυθμιζόμενες παραμέτρους. Η διαδικασία εκπαίδευσης του αλγορίθμου περιλαμβάνει τον προσδιορισμό αυτών των παραμέτρων με βάση τα έτοιμα σύνολα δεδομένων. Ο στόχος είναι να διασφαλιστεί ότι οι παράμετροι αντανακλούν τελικά τα υποκείμενα μοτίβα στα δεδομένα.

Στόχος είναι, με την ολοκλήρωση της εκπαίδευσης, οι παράμετροι να αποτυπώνουν με ακρίβεια την ουσία των δεδομένων που συλλέγονται. Στη συνέχεια, όταν χρησιμοποιείται ο αλγόριθμος με αυτές τις παραμέτρους, καθίσταται δυνατή η πρόβλεψη των αποτελεσμάτων – όπως ο προσδιορισμός του εάν ένα νέο βιογραφικό σημείωμα δικαιολογεί την πρόσληψη – με βάση τα μαθησιακά πρότυπα του μοντέλου.

Ακούω ότι τροφοδοτείτε τον αλγόριθμο με δεδομένα. Έτσι, εάν ένα προκατειλημμένο άτομο τροφοδοτεί τον αλγόριθμο με δεδομένα, τότε το τελικό σύστημα θα είναι προκατειλημμένο; Πώς γεννούνται οι προκαταλήψεις στα συστήματα ΤΝ;

Συνήθως αυτό που λέμε είναι ότι ξεκινάμε με έναν αλγόριθμο με κάποιες παραμέτρους και μετά όταν βελτιστοποιούμε τις παραμέτρους χρησιμοποιώντας τα δεδομένα, μόλις τελειώσουμε μιλάμε για ένα “μοντέλο” και το μοντέλο είναι, ουσιαστικά, ο αλγόριθμος με τις παραμέτρους που έχουν βελτιστοποιηθεί με βάση τα δεδομένα.

Επομένως, υπάρχουν διαφορετικοί τρόποι με τους οποίους μπορεί να εισέλθει η μεροληψία στη διαδικασία αυτή. Ένας από τους κύριους τρόπους είναι μέσω των δεδομένων που χρησιμοποιούμε για τη βελτιστοποίηση των παραμέτρων, με ένα άτομο που συλλέγει και επεξεργάζεται τα σύνολα δεδομένων πχ. Για παράδειγμα, έχετε ιστορικό βιογραφικών που χρησιμοποιείτε ως δεδομένα, αλλά επειδή στο παρελθόν δεν έχετε προσλάβει πολλές γυναίκες ή POC, το σύνολο δεδομένων σας είναι προκατειλημμένο, λείπει έντονα από τα δεδομένα το άλλο φύλο. Έτσι, τελικά θα βελτιστοποιήσουμε τον αλγόριθμο με αυτά τα δεδομένα που είναι μεροληπτικά\biased. Ο αλγόριθμος, δεν έχει “δει” τα δεδομένα των γυναικών υποψηφίων, δεν θα προβλέψει πρόσληψη βιογραφικών από γυναίκες.

Επίσης, ο τρόπος με τον οποίο τροφοδοτούμε τα δεδομένα στον αλγόριθμο μπορεί να έχει αντίκτυπο σε ζητήματα συμπερίληψης. Και πάλι παίζει ρόλο το άτομο που αναπτύσσει τα δεδομένα, τον αλγόριθμο και το μοντέλο, γιατί λόγω της δικής του μεροληψίας μπορεί να μην έχει επίγνωση αυτής της έλλειψης ποικιλομορφίας στα δεδομένα.

Για να δημιουργήσουμε το τελικό μοντέλο χρειαζόμαστε τα δεδομένα και τον βασικό αλγόριθμο και πρέπει να βρούμε έναν τρόπο να το συνδυάσουμε. Υπάρχουν διαφορετικοί τρόποι και μερικοί τρόποι μπορούν να αγνοήσουν όλες τις προκαταλήψεις στα δεδομένα, κάποιοι μπορεί να είναι περισσότερο ενήμεροι, αλλά τότε έχουμε τη διασταύρωση των προκαταλήψεων, οπότε ακόμα κι αν γνωρίζουμε ότι θέλουμε να απαλείψουμε μία προκατάληψη, υπάρχουν μαθηματικοί περιορισμοί στο τι μπορεί να κάνει ένας αλγόριθμος , ώστε να μπορούμε μαθηματικά να αποφύγουμε το bias, ας πούμε μπορεί να μπορούμε να αποφύγουμε την προκατάληψη του φύλου αλλά όχι τη φυλετική προκατάληψη.

Πώς αντιμετωπίζουν επί του παρόντος οι ρυθμιστικές αρχές το bias της τεχνητής νοημοσύνης;

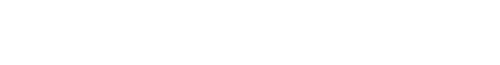

Επειδή η μεροληψία μπορεί να προέλθει από τα δεδομένα, από τον αλγόριθμο ή από τον τρόπο που συνδυάζετε τα δύο, υπάρχουν οι κύριοι τύποι μεθόδων για να κάνουμε debias το μοντέλο. Κάποιοι περιστρέφονται γύρω από τα τα δεδομένα, κάποιοι βασίζονται στον αλγόριθμο και τον συνδυασμό των δύο και ο τελευταίος τρόπος με τον οποίο μπορούμε να κάνουμε debias ένα μοντέλο είναι η μεταγενέστερη επεξεργασία του τι κάνει το μοντέλο στη συνέχεια, μετά τη δημιουργία του.

Στη συλλογή δεδομένων, για παράδειγμα, ο επιστήμονας προσπαθεί να βρει περισσότερα βιογραφικά γυναικών, ας πούμε, και συχνά, αυτό που κάνουν οι άνθρωποι στην επιστήμη των υπολογιστών είναι απλώς να συνθέτουν νέα CVs, δηλαδή να αντιγράφουν αυτά που έχουν και να αλλάζουν το όνομα και φύλο, για να έχουν ένα βιογραφικό σχεδόν πραγματικό και μετά να έχουν στοιχεία και από γυναίκες.

Όταν η μεροληψία βρίσκεται στον αλγόριθμο και στον τρόπο που συνδυάζεται με τα δεδομένα, προσθέτουμε μερικούς περισσότερους περιορισμούς ας πούμε στον αλγόριθμο και τον τρόπο με τον οποίο χρησιμοποιεί τα δεδομένα και προσπαθούμε να δώσουμε εντολή να δίνει μεγαλύτερη προσοχή στα βιογραφικά των γυναικών, αλλάζοντας τις παραμέτρους της εξίσωσης ώστε να εστιάζει περισσότερο στα γυναικεία δεδομένα.

Στο τελευταίο βήμα της, αυτό του debiasing του μοντέλου μετά την επεξεργασία του, εξετάζουμε τα αποτελέσματα που παρέχει και τις πληροφορίες που παρέχει-συνήθως ένας αλγόριθμος έχει πολλές πληροφορίες ως προς το αποτέλεσμα, παρέχοντας κάποιου είδους ποσοστό βεβαιότητας για τις αποφάσεις που προβλέπει ότι πρέπει να ληφθούν. Έτσι, όταν βλέπουμε χαμηλή βεβαιότητα, ίσως θα έπρεπε να δώσουμε την τελευταία απόφαση σε έναν άνθρωπο.

Για να δημιουργήσουμε αυτό το μοντέλο χρειαζόμαστε τα δεδομένα και τον αλγόριθμο, αλλά ακόμη και πριν από αυτό θα πρέπει να αποφασίσουμε τι κάνει ένα μοντέλο γενικά. Για παράδειγμα, αν μιλάμε για αποδοχή ή απόρριψη βιογραφικού, μπορεί να είναι δύσκολο να βρούμε δεδομένα, ας πούμε, εάν θέλουμε να συμπεριλάβουμε και άλλες υποαντιπροσωπευόμενες ομάδες, ας πούμε non binary people, στη διαδικασία. Έτσι, μερικές φορές το bias μπορεί να είναι ακούσιο, οι άνθρωποι πολλές φορές θα χρησιμοποιήσουν τα δεδομένα που έχουν διαθέσιμα, παλιά δεδομένα και κοινωνικές νόρμες του παρελθόντος.

Υπάρχει ένας τομέας έρευνας όπου οι άνθρωποι συνήθιζαν να παίρνουν φωτογραφίες ανθρώπων και να προσπαθούν να προβλέψουν διαφορετικά πράγματα όπως ο σεξουαλικός προσανατολισμός, οι εγκληματικές τάσεις, ξεκινούσαν από βιομετρικά δεδομένα και μετά προσπαθούσαν να προβλέψουν αυτές τις τάσεις. Αυτό έχει θέσει επίσης ερωτήματα ηθικής γενικά.

Ποιες είναι οι συνέπειες του να βασιζόμαστε αποκλειστικά σε αλγόριθμους και σύνολα δεδομένων (τεχνικό debiasing) για την αντιμετώπιση των διακρίσεων στην τεχνητή νοημοσύνη και ποιες εναλλακτικές προσεγγίσεις θα μπορούσαν να εξεταστούν;*

Αυτή είναι η πρόκληση, τελικά δεν έχουμε μια καλή μέθοδο για να αναπτύξουμε ένα μοντέλο που να είναι αμερόληπτο. Το “αμερόληπτο” δεν σημαίνει τίποτα στην πράξη, τα πράγματα είναι πραγματικά υποκειμενικά ούτως ή άλλως, και αυτό σημαίνει προκατάληψη. Έχω ακούσει μηχανικούς να μου λένε ότι κατασκευάζουν αμερόληπτα CHAT GPT, αφαιρώντας κάθε ρητορική μίσους, αλλά αυτό εξαρτάται από την κουλτούρα σου, τη νομοθεσία στη χώρα σου κ.λπ., οπότε το τι σημαίνει προκατάληψη είναι στην πραγματικότητα βαθιά πολιτισμικά εξαρτώμενο, επομένως είναι πραγματικά υποκειμενικό.

Έχουμε μετρήσεις για τη μέτρηση του επιπέδου της μεροληψίας, όχι επαρκείς, αλλά δεν πρέπει να αγνοηθούν εντελώς προς το παρόν, είναι η μόνη μέθοδος που έχουμε. Μπορούν να βοηθήσουν λίγο. Για παράδειγμα, στον νόμο AI που ψήφισε η ΕΕ, προσπαθούμε να κάνουμε κάποιους ελέγχους. Αν έχουμε μια μέτρηση για να μπορούμε να κάνουμε ερωτήσεις και αυτό είναι κάτι. Αλλά τότε πρέπει να μιλήσουμε για τους προγραμματιστές και τους decision makers, είναι αυτοί που πρέπει να είναι επικριτικοί με τις προσεγγίσεις, να αμφισβητούν την ποικιλομορφία των δεδομένων, πώς να κωδικοποιούν το φύλο κ.λπ., δεν χρειάζονται πραγματικά έναν πολύπλοκο αλγόριθμο για να σκεφτούν. Δεν είναι καθαρά τεχνοκρατικό το ζήτημα.

Στην πραγματικότητα είναι θέμα προβληματισμού σχετικά με τις αποφάσεις σχεδιασμού. Οι επιστήμονες υπολογιστών δεν μιλούν πραγματικά γι ‘αυτό, δεν πιστεύουν ότι είναι δουλειά τους να το κάνουν, δεν είναι θέμα αλγορίθμου, το βλέπουν περισσότερο ως θέμα ηθικής και ως θέμα αποφάσεων που δεν είναι δουλειά τους να πάρουν. Έχω πάρει συνεντεύξεις από πολλούς προγραμματιστές σχετικά με αυτό το ζήτημα της μεροληψίας, και αν και κάποιοι καταλαβαίνουν ότι οι σχεδιαστικές αποφάσεις που παίρνουν επηρεάζουν τους ανθρώπους, πολλοί είναι σε οργανισμούς που δεν έχουν τους δίνουν τον προϋπολογισμό, τον χρόνο και την πληροφορία για να σκεφτούν πραγματικά.

*Λαμβάνοντας υπόψη τους περιορισμούς των τεχνικών debiasing, οι υπεύθυνοι χάραξης πολιτικής θα πρέπει να μην υποστηρίζουν μόνο τo αυστηρά τεχνοκρατικό debiasing ως απάντηση στη μη συμπεριληπτική τεχνητή νοημοσύνη, καθώς η εφαρμογή τους είναι πολύ στενή – If AI is the problem, is debiasing the solution?

Πώς μπορούν οι υπεύθυνοι χάραξης πολιτικής να διασφαλίσουν ότι η ρύθμιση της τεχνητής νοημοσύνης προστατεύει και θέτει υπόλογους τόσο τους οργανισμούς όσο και τους δημόσιους φορείς καθώς υιοθετούν συστήματα που βασίζονται σε τεχνητή νοημοσύνη;

Στην πραγματικότητα δεν έχουμε ακόμα τίποτα, ο νόμος της ΕΕ για την τεχνητή νοημοσύνη έχει αυτές τις κατηγορίες κινδύνου και νομίζω ότι θα ήταν δύσκολο να προχωρήσουμε από αυτόν τον κανονισμό σε ορισμένους συγκεκριμένους ελέγχους bias.

Δεν είναι εφικτό να συμπεριληφθεί αυτό στον νόμο για την τεχνητή νοημοσύνη, ο οποίος πρέπει να είναι γενικός. Ωστόσο, απαιτούνται κάποια είδη προτύπων για να αποφασίσουμε για κάθε διαφορετική εφαρμογή, καθώς η υπολογιστική επιστήμη δεν έχει την εκπαίδευση να εξετάζει όλες αυτές τις μεθόδους. Όσον αφορά την υπολογιστική έρευνα, επιδιώκεται η δημιουργία μιας γενικευμένης μεθόδου, αλλά κανείς δεν μπορεί να αναλάβει την ευθύνη για την γενίκευση που είναι απαραίτητη.

Χρειάζονται τόσο οι υπεύθυνοι λήψης αποφάσεων όσο και οι επιστήμονες υπολογιστών εκπαίδευση και ευαισθητοποίηση σχετικά με την προκατάληψη στα συστήματα τεχνητής νοημοσύνης;

Οι υπεύθυνοι λήψης αποφάσεων πρέπει να γνωρίζουν την ύπαρξη προβλήματος και να διαθέτουν τόσο χρόνο όσο και προϋπολογισμό για εκπαίδευση στην υπολογιστική υποδομή, χωρίς να έχουν βαθιά κατανόηση της επιστήμης των δεδομένων. Επιπλέον, οι επιστήμονες υπολογιστών πρέπει να συνειδητοποιήσουν τη σημασία των αποφάσεών τους, και ίσως θα έπρεπε να υπάρχουν τρίτες εταιρείες με τις αντίστοιχες γνώσεις και εξουσιοδοτήσεις που θα εξετάζουν και θα επικυρώνουν αυτές τις αποφάσεις.

Πιστεύετε ότι αυτά τα συστήματα, όντας πιο αντικειμενικά, εάν ρυθμιστούν και χρησιμοποιηθούν με τον καλύτερο τρόπο, θα μπορούσαν με οποιονδήποτε τρόπο να είναι σύμμαχοι της διαφορετικότητας, της διαφάνειας και της ένταξης στις επιχειρήσεις;

Νομίζω ότι αυτό σκέφτηκαν οι άνθρωποι αρχικά, η ιδέα ήταν ότι ο σχεδιασμός αυτός θα μετριάσει την ανθρώπινη προκατάληψη. Πράγματι, οι αποφάσεις είναι συνεπείς, χρησιμοποιώντας το ίδιο μοντέλο μερικές φορές, το αν είναι λιγότερο προκατειλημμένες από την ανθρώπινη λήψη αποφάσεων, εξαρτάται από το πόσο regulated και thoughtful είναι.

Υπάρχει αυτή η ανησυχία ότι η εφαρμογή AI ενισχύει τις υπολογιστικές υποδομές στα χέρια των Big Tech και ότι μπορεί να επηρεάσει τους κανονισμούς γύρω από την ΤΝ.

Φυσικά, υπάρχουν ομάδες πίεσης (lobbyists) που επιδιώκουν να επηρεάσουν τους απαιτούμενους ελέγχους και τις προδιαγραφές περί προκατάληψης. Κάποιοι παρέχουν μοντέλα και επιβάλλουν τις δικές τους αξίες και κοινωνικούς κανόνες σε αυτά που θα έπρεπε να είναι αμερόληπτα, θέτοντας κανόνες από τους προγραμματιστές τους. Πολλές εταιρείες παρέχουν επίσης την υποδομή για τη δημιουργία και τη διατήρηση αυτών των μοντέλων, αλλά το θέμα δεν είναι μόνο η προκατάληψη ή η επιρροή που έχουν στους οργανισμούς. Αν ο οργανισμός δεν μπορεί να στηρίξει οικονομικά αυτήν την εξάρτηση, μπορεί να προκαλέσει πολλά ζητήματα σχετικά με τη λήψη αποφάσεων, την προστασία δεδομένων και άλλα.

Ορισμένες μεγάλες εταιρείες τεχνολογίας χρησιμοποιούν τα δικά τους δεδομένα για να δημιουργήσουν το τελικό μοντέλο, αλλά αν θέλουν να δημιουργήσουν ένα μοντέλο κατάλληλο για έναν οργανισμό θα χρειαστούν τα δεδομένα από τον οργανισμό και έτσι υπάρχουν ζητήματα απορρήτου, ξέρουμε τι θα κάνουν με αυτά τα δεδομένα; Το βλέπουμε αυτό με το LLMS-χρειαζόμαστε τρομερά πολλά δεδομένα για να εκπαιδεύσουμε το LLM. Οι οργανισμοί που τα αναπτύσσουν για άλλους οργανισμούς και πελάτες, πιθανότατα θα χρησιμοποιούσαν τα δεδομένα από αυτά τα όργανα όλα μαζί για τη δημιουργία του τελικού μοντέλου και εξαιτίας αυτής της μίξης δεδομένων υπάρχουν ζητήματα ιδιωτικότητας και διαρροής.

Πώς είναι το μέλλον στη χρήση της ΤΝ στον κόσμο της εργασίας;

Υπάρχουν επιπλέον θέματα που πρέπει να εξετάσουμε σχετικά με την εφαρμογή της τεχνητής νοημοσύνης. Η απαίτηση για μεγάλο όγκο δεδομένων επιφέρει προβλήματα σε σχέση με το περιβάλλον και την ενέργεια που καινε τα computational infrastructures, καθώς και ζητήματα ηθικής των εργαζομένων (crowd workers) πρέπει να αναλάβουν τη συλλογή και τον σχολιασμό των δεδομένων που χρησιμοποιούνται για την ανάπτυξη των μοντέλων. Αυτές οι δραστηριότητες διεξάγονται από ανθρώπους. Επομένως, υπάρχουν επιπλέον ερωτήματα σχετικά με τις πιθανές αρνητικές επιπτώσεις της χρήσης της τεχνητής νοημοσύνης. Εκτός από την προκατάληψη, οι λύσεις τεχνητής νοημοσύνης μπορεί να αποδειχθούν ηθικά ή περιβαλλοντικά ανεπαρκείς, επομένως απαιτείται προσέγγιση προτεραιοτήτων και ρύθμισης για την αντιμετώπιση αυτών των θεμάτων.

Δεν ξέρω ποιος πρέπει να πάρει αυτές τις αποφάσεις, είναι θέμα πώς δημιουργείς αυτό το μοντέλο. Για παράδειγμα, θα εμπιστευόμουν ένα μοντέλο που δημιουργήθηκε από μια πιο διαφορετική ομάδα ή μια εταιρεία που έδωσε προϋπολογισμό και κίνητρα στην ομάδα προγραμματιστών, ώστε να σκεφτούν και να ερευνήσουν πριν δημιουργήσουν το μοντέλο και η τελική πτυχή που θα κοιτούσα είναι όταν έχουμε το μοντέλο και χρησιμοποιώντας το, αν γνωρίζουμε ότι είναι μεροληπτικό, θα τα χρησιμοποιούσαμε; Θα είχαμε μια δεύτερη ανθρώπινη κρίση ή ανθρώπινη επανεξέταση; Συνεπώς, πιστεύω ότι εξαρτάται από τον τρόπο χρήσης του μοντέλου.

*Η Agathe μίλησε ιδιαίτερα για ζητήματα μεροληψίας και συμπερίληψης όσον αφορά το φύλο, τη φυλή κ.λπ. Ωστόσο, τόνισε ότι ορισμένοι μελετητές έχουν επίσης ερευνήσει τα προβλήματα που σχετίζονται με την αλγοριθμική πρόσληψη και τις αναπηρίες.

Γλωσσάρι Βασικών Όρων

Datasets: Ένα σύνολο δεδομένων-datasets-είναι μια συλλογή δεδομένων.

Αλγόριθμος: Στα μαθηματικά και την επιστήμη των υπολογιστών, ένας αλγόριθμος είναι μια πεπερασμένη ακολουθία αυστηρών εντολών, που χρησιμοποιούνται συνήθως για την επίλυση μιας κατηγορίας συγκεκριμένων προβλημάτων ή για την εκτέλεση ενός υπολογισμού. Οι αλγόριθμοι χρησιμοποιούνται ως προδιαγραφές για την εκτέλεση υπολογισμών και επεξεργασίας δεδομένων.

Παράμετροι: Οι παράμετροι στη μηχανική μάθηση και τη βαθιά μάθηση είναι οι τιμές που ο αλγόριθμος εκμάθησής σας μπορεί να αλλάξει ανεξάρτητα καθώς μαθαίνει και αυτές οι τιμές επηρεάζονται από την επιλογή των υπερπαραμέτρων που παρέχετε. Έτσι, ορίζετε τις υπερπαραμέτρους πριν ξεκινήσει η εκπαίδευση και ο αλγόριθμος εκμάθησης τις χρησιμοποιεί για να μάθει τις παραμέτρους. Πίσω από το σκηνικό της εκπαίδευσης, οι παράμετροι ενημερώνονται συνεχώς και οι τελικές στο τέλος της εκπαίδευσης αποτελούν το μοντέλο σας.

Μοντέλο: Το τελικό αποτέλεσμα μετά την εκπαίδευση του αλγορίθμου, χρησιμοποιώντας παραμέτρους και σύνολα δεδομένων.

Συνθετικά δεδομένα: Τα συνθετικά δεδομένα είναι πληροφορίες που δημιουργούνται τεχνητά αντί να παράγονται από γεγονότα του πραγματικού κόσμου. Συνήθως δημιουργούνται με χρήση αλγορίθμων, τα συνθετικά δεδομένα μπορούν να αναπτυχθούν για την επικύρωση μαθηματικών μοντέλων και την εκπαίδευση μοντέλων μηχανικής μάθησης.

Κωδικοποίηση: Στην τεχνολογία υπολογιστών, η κωδικοποίηση είναι η διαδικασία εφαρμογής ενός συγκεκριμένου κώδικα, όπως γράμματα, σύμβολα και αριθμοί, σε δεδομένα για μετατροπή σε ισοδύναμο κρυπτογράφηση.

Crowd Workers: Αυτό που ονομάζουμε πλατφόρμες crowdsourcing είναι πλατφόρμες όπου σε μεγάλες, κατανεμημένες ομάδες εργαζομένων (που ονομάζονται πλήθος εργαζομένων) δίνονται «μικροεργασίες» για να βοηθήσουν στη συλλογή και τον σχολιασμό δεδομένων που προορίζονται για εκπαίδευση ή αξιολόγηση AI. Τυπικά, είναι μια έξυπνη λύση για τη δημιουργία των συνόλων δεδομένων γρήγορα και εύκολα, δεδομένης της ικανότητας του crowdsourcing να δημιουργεί προσαρμοσμένα δεδομένα κατά ζήτηση και σε κλίμακα. Ωστόσο, είναι επίσης ένα ζήτημα που συχνά παραβλέπεται αν και είναι κρίσιμο μέρος του κύκλου ζωής της τεχνητής νοημοσύνης, όσον αφορά τις ηθικές συνθήκες εργασίας.

ADMS: Τα Αυτοματοποιημένα Συστήματα Λήψης Αποφάσεων είναι προγραμματισμένοι αλγόριθμοι που υπολογίζουν δεδομένα προκειμένου να παράγουν μια ενημερωμένη αυτοματοποιημένη απόφαση για διάφορα θέματα. Τα ADMS έχουν χρησιμοποιηθεί σε δικαστικές, κυβερνητικές και κοινωνικές υπηρεσίες προκειμένου να αντιμετωπιστούν τομείς που έχουν καταπονηθεί και δεν διαθέτουν πόρους.